- Yandex Research, ISTA и KAUST разработали методы сжатия языковых моделей для сокращения расходов на внедрение нейросетей.

- Решение позволяет уменьшить размер моделей и запускать их на устройствах с меньшими вычислительными ресурсами.

- Метод Яндекса сохраняет до 95% качества моделей при сжатии.

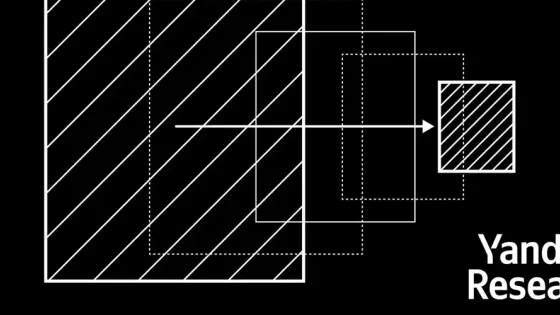

- Решение включает два инструмента: один для уменьшения размера модели и ускорения работы, другой для исправления ошибок сжатия.

- Эффективность методов была проверена на моделях с открытым исходным кодом, включая Llama 2, Llama 3 и Mistral.

- Метод Яндекса показал лучший результат среди всех существующих методов сжатия, сохраняя в среднем 95% качества ответов нейросети.

- Код новых методов сжатия опубликован на GitHub, доступны сжатые модели и обучающие материалы для разработчиков.

- Работа о методе сжатия AQLM была представлена на конференции ICML в сотрудничестве с ISTA и Neural Magic.

В Яндексе придумали, как бизнесу сократить расходы на ИИ в 8 раз

23 июл 2024

Краткий пересказ

от нейросети YandexGPT

Источник:

hightech.plus