- GigaChat MAX - флагман компании, использующий перспективную MoE-архитектуру.

- Модель GigaChat-20B-A3B - младшая модель линейки GigaChat с мультиязычными возможностями.

- Модель обучалась на триллионах токенов русского текста и способна понимать другие языки.

- GigaChat-20B-A3B доступна в открытом доступе на HuggingFace с поддержкой длинного контекста.

- Модель может быть использована через transformers, cpu-offloading и vllm.

- GigaChat-20B-A3B имеет высокую скорость генерации новых токенов и сравнима с 3В-моделями.

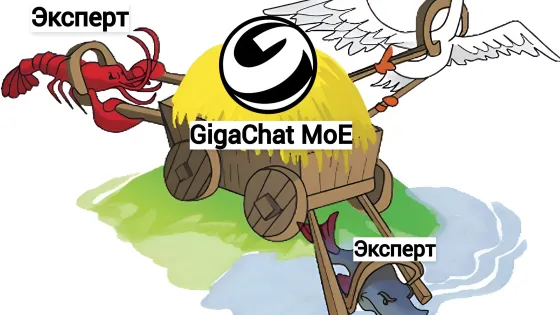

- Модель использует архитектуру «Mixture of Experts» (MoE) для выбора экспертов для разных областей знаний.

- MoE-эксперты специализируются на разных темах, и модель может быть использована для генерации ответов на определенные темы без дополнительного обучения.

- Пересказана только часть. Для продолжения перейдите в режим подробного пересказа.

Сбер выкладывает GigaChat Lite в открытый доступ

14 дек 2024

Краткий пересказ

от нейросети YandexGPT

Источник:

habr.com

Обложка: Изображение из статьи