- LLM (Large Language Models) были похожи на детей, говорили первое, что приходит в голову, и не заботились о логике.

- Многие считали, что у моделей нет настоящего интеллекта и их необходимо дополнять человеческой помощью или внешним каркасом.

- Крупные разработчики LLM, такие как OpenAI, решили воспроизвести внешний этап мышления внутри модели.

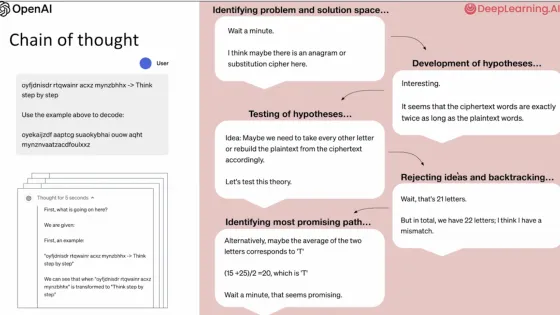

- Reasoning LLMs разбивают проблемы на мелкие части, используют подход «цепочки рассуждений» и пробуют несколько стратегий перед ответом.

- Требования к вычислительным ресурсам (GPU) будут расти, так как более длительное «размышление» приводит к лучшим ответам.

- Мини-модели и полноценные модели используются для разных задач, например, программирование, математика и наука.

- В ближайшем будущем можно будет значительно повысить качество моделей, добавляя больше вычислительных ресурсов и улучшая обучающие датасеты.

- Следующим крупным шагом станет реализация многоагентной архитектуры на уровне LLM для разделения единой памяти и контекста.

Думающие модели o1-3: краткий обзор и чего программистам ждать дальше

13 янв 2025

Краткий пересказ

от нейросети YandexGPT

Источник:

habr.com