- Ученые из МФТИ исследовали, как изменяется и стабилизируется процесс обучения нейросетей при добавлении новых данных.

- Исследование основано на теоретическом анализе и обширных экспериментах.

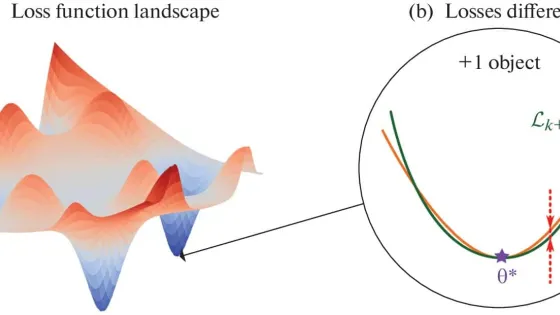

- Ландшафт функции потерь нейросети сходится к определенной форме при увеличении размера выборки.

- Это имеет важные последствия для глубинного обучения и разработки методов определения необходимого объема данных.

- Нейронные сети являются мощным инструментом искусственного интеллекта, лежащим в основе множества технологий.

- Обучение нейросети - это поиск оптимальных настроек параметров, минимизирующих ошибки предсказаний.

- Ключевым понятием является функция потерь - математическая мера «неправильности» работы нейросети на данном этапе обучения.

- Исследование показало, что ландшафт функции потерь стабилизируется по мере увеличения размера выборки.

- Результаты исследования могут помочь в разработке методов определения достаточного размера выборки и оптимизации вычислительных архитектур и алгоритмов машинного обучения.

Изображение: (a) ландшафт функции потерь, который является поверхностью в пространстве параметров. (b) разница потерь, которая возникает, когда к набору данных добавляется еще один объект / © Kiselev, N.S., Grabovoy, A.V., Doklady Mathematics